海光GPU及开发平台简介

前言

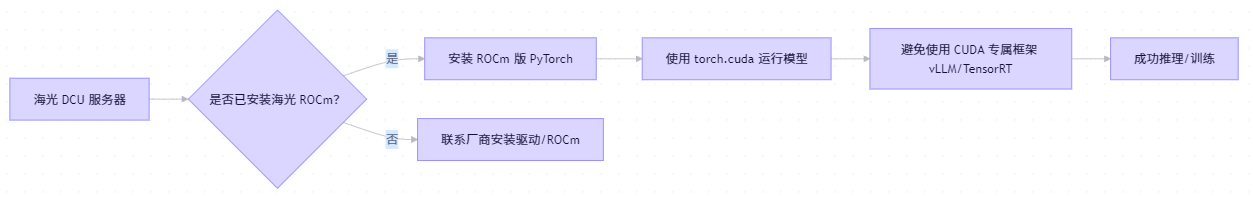

截至目前(2026 年),海光(Hygon)GPU 主要基于 DCU(Deep Computing Unit)架构,其硬件兼容 AMD 的 CDNA 架构,并通过 ROCm(Radeon Open Compute)平台 提供 AI 加速支持。因此,在海光 GPU 上运行 AI 模型的核心路径是:使用 ROCm 生态 + 兼容框架。

ROCm 是 AMD 为自家 GPU(包括 Instinct 加速卡、Radeon 专业卡和部分消费级显卡)打造的 GPU 计算生态系统,对标 NVIDIA 的 CUDA。

PyTorch、TensorFlow、ONNX Runtime 等均有官方或社区 ROCm 适配版

ModelScope

海光DCU

海光平台 DCU指的是由海光信息(Hygon)自主研发的、基于其 DCU(Deep Computing Unit,深度计算单元)加速芯片构建的高性能计算软硬件平台。

架构兼容性

- 基于 ROCm(Radeon Open Compute)生态开发;

- ROCm 与 NVIDIA 的 CUDA 高度相似,因此被称为 “类 CUDA” 环境;

- 这使得大量原本为 CUDA 编写的 AI 框架(如 PyTorch、TensorFlow)可较低成本迁移到海光 DCU 平台。

海光开发者社区

简介

- 驱动是显卡驱动。

- DTK就相当于英伟达平台的CUDA Toolkit,必须要安装,版本要和驱动版本兼容。

- DAK是AI相关的软件包。

- 光源 镜像和测试过能使用的模型仓库,里面有模型的调用方式,不包含模型,模型还要从ModelScope上下载。

光源提供了集成相关组件的镜像,我们可以运行镜像在镜像内进行AI模型的调用

例如

下面这个镜像就是Ubuntu22.04的系统安装了DTK25.04.1,安装了vLLM0.8.5和Python3.10

1 | docker run -it \ |

常用镜像

pytorch镜像

vllm

适配说明

驱动安装

查看驱动是否安装

1 | lsmod | grep hycu |

检查当前 Linux 系统内核中是否已加载名为 hycu 的内核模块(驱动)。

在海光(Hygon)GPU 生态中,hycu 通常是 海光计算单元(Hygon Compute Unit)驱动模块的名称。

它是海光自研 GPU(如 P800、W100)在 Linux 系统中的核心内核驱动。

查看显卡型号

1 | clinfo | grep -A 2 "Device Type" |

可以看到Board name

1 | Device Type: CL_DEVICE_TYPE_GPU |

GPU信息

GPU管理工具

1 | /opt/hyhal/bin/hy-smi |

hy-smi 是 海光(Hygon)自研 GPU(如 P800、W100 等)配套的系统管理接口工具。

功能类似于 NVIDIA 的 nvidia-smi 或 AMD 的 rocm-smi,用于监控和管理海光 GPU 的状态,

包括:

- 显存使用情况(总显存、已用、空闲)

- GPU 利用率

- 温度、功耗

- 驱动版本

- 设备拓扑等

输入

1 | hy-smi |

信息说明

你提供的 hy-smi(或类似海光 GPU 监控工具)输出信息如下:

1 | HCU Temp AvgPwr Perf PwrCap VRAM% HCU% Mode |

这是对 两张海光 GPU(HCU = Hygon Compute Unit) 的实时状态监控。下面逐列解释其含义:

各列详细说明

| 列名 | 含义 | 你的值示例 | 说明 |

|---|---|---|---|

| HCU | GPU 设备编号 | 0, 1 |

表示系统中第 0 号和第 1 号海光 GPU |

| Temp | 温度 | 61.0°C, 62.0°C |

GPU 芯片当前温度,正常工作范围通常为 30–85°C |

| AvgPwr | 当前平均功耗 | 108.0W, 112.0W |

GPU 实时功耗,远低于上限,说明负载很低 |

| Perf | 性能状态 | auto |

表示 GPU 处于自动频率调节模式(类似 NVIDIA 的 “P2” 或 “P8” 状态) |

| PwrCap | 功耗上限(TDP) | 400.0W |

该 GPU 最大允许功耗为 400W(典型如 P800/W100 的规格) |

| VRAM% | 显存使用率 | 0% |

当前显存占用比例为 0% —— 注意:这只是使用率,不是总显存大小! |

| HCU% | 计算单元利用率 | 0.0% |

GPU 核心计算单元空闲,无任务运行 |

| Mode | 运行模式 | Normal |

正常工作模式(非维护、节能或故障状态) |

常用指令

查看剩余显存

1 | hy-smi --showmemavailable |

显示总显存和已用显存

1 | hy-smi --showmeminfo vram |

查看是否有进程在使用 GPU

1 | hy-smi --showpids |

查看显存是否启用 ECC(关键用于稳定性)

1 | hy-smi --showmemeccinfo |

总结速查表

| 目标 | 推荐参数 |

|---|---|

| 总显存 / 已用显存 | --showmeminfo vram |

| 剩余可用显存 | --showmemavailable |

| GPU 核心频率 | -g 或 -c |

| 显存频率 | -c 或 --showclkfrq |

| 功耗上限 | -M |

| 当前运行的 GPU 进程 | --showpids |

| ECC 错误检查 | --showmemeccinfo |

前提条件

确认你的海光 GPU 型号和驱动

必须安装 海光官方提供的 ROCm 兼容驱动栈(通常由服务器厂商或海光提供,非公开下载)。

验证命令(需 root 或 sudo):

1 | rocminfo # 查看 ROCm 设备信息 |

推理环境

推理环境要用海光提供的兼容版本

比如PyTorch、vLLM等

海光 GPU 调用 AI 模型路线图